USB-Technologie verstehen – Jenseits des Marketings

Kontinuierliche Analysen zu Flash-Speichern, USB-Technologie und Datensicherheit – klar erklärt für alle, die verstehen wollen, was tatsächlich im Hintergrund passiert.

Kernwissensbereiche

Flash-Speicher

Wie NAND funktioniert, Mythen uber die Lebensdauer, Performance-Verhalten und Preisentwicklungen.

USB-Sicherheit

Kopierschutz, Risiken von Datenlecks, Schreibschutz und Compliance-Realitäten.

Datenintegritaet

Testwerkzeuge, gefälschte Kapazitäten, Korruptionsprobleme und Verifizierungsmethoden.

USB-Hardware

Was steckt in einem Flash-Laufwerk, Firmware-Verhalten und Performance-Kompromisse.

Kopiersysteme

Massenkopieren, Verifizierungsmethoden und Workflow-Design.

Branchenanalyse

Marktveränderungen, Lieferengpässe, KI-Nachfrage und Dynamik der Flash-Preise.

Hervorgehobene Analyse

Tiefgründige Einblicke in reales USB-Verhalten, Ökonomie von Flash-Speichern, Controller-Entscheidungen und Sicherheits-Kompromisse.

Neueste Artikel

KV Cache: Das KI-Speicherreservoir, das GPUs nicht austrocknen lässt

Mara Vale: Das Echo der Air-Gap | Cyberpunk Noir über unsichtbare Signale und Datenlecks

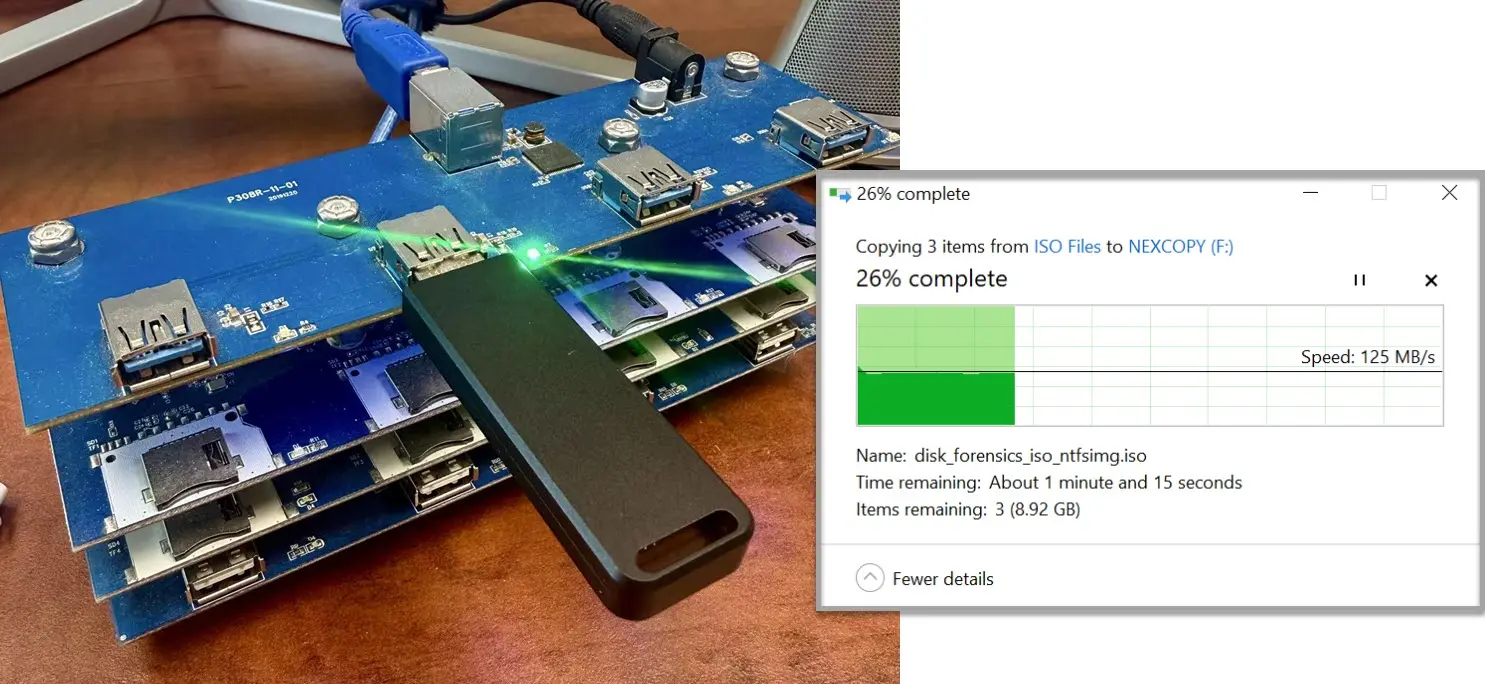

Warum Ihr 300MB/s-USB-Stick nach 20 Sekunden langsamer wird

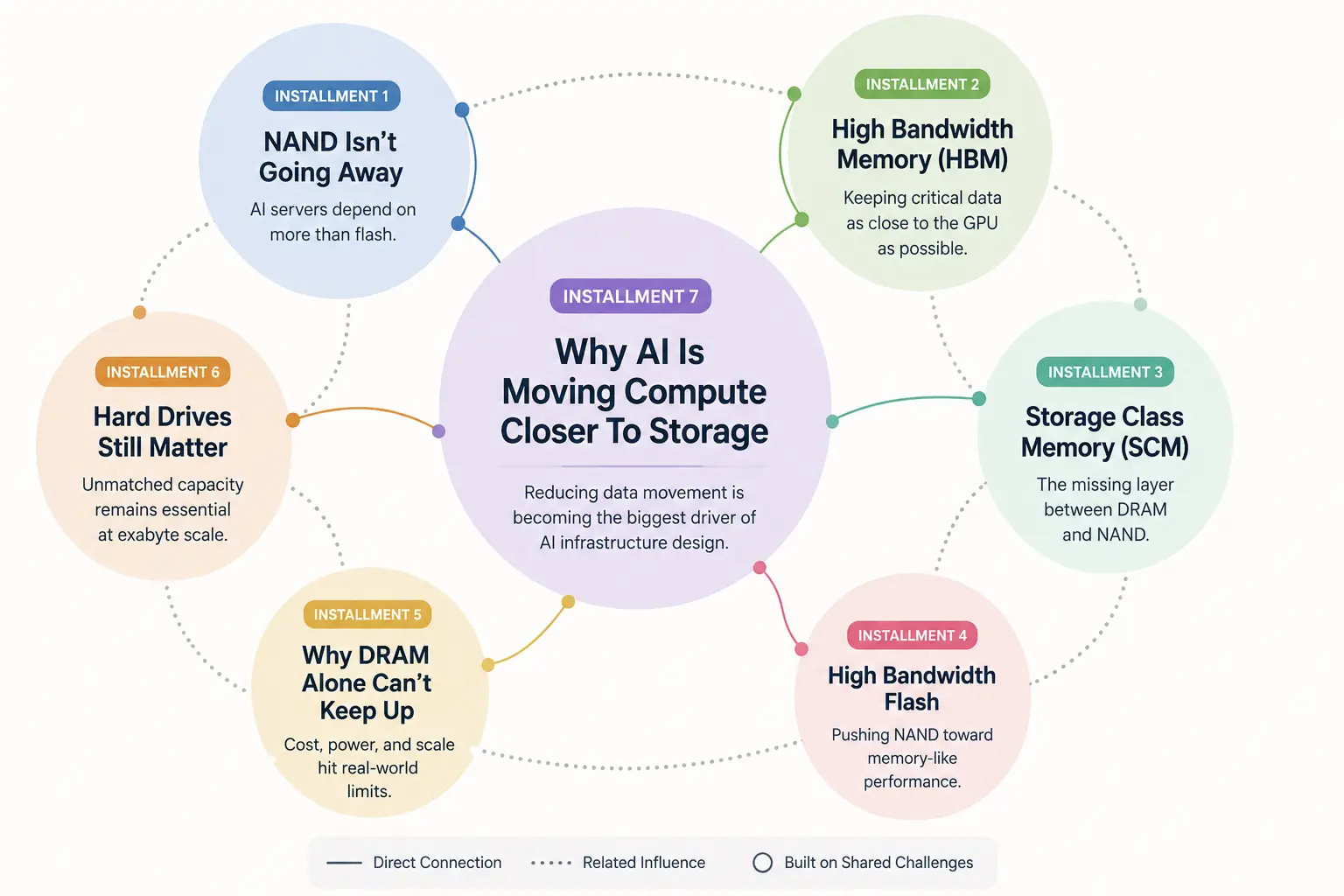

Warum KI Compute näher an den Speicher heranrückt

Wussten Sie überhaupt, dass Samsungs Streikdrohung die Speicherlieferkette beeinflussen könnte?