Flash-Speicher hält die Daten der Welt fest – aber nicht seine eigene Geschichte

Wenn man nach einem Museum sucht, das sich dem Flash-Speicher widmet, fällt das Ergebnis überraschend dürftig aus. Es gibt eines – versteckt in einer Speichereinrichtung in China, teils Showroom, teils historische Ausstellung – aber es ist kein Ort, den die Öffentlichkeit besucht, und es ist auch nicht als dauerhaftes Archiv gedacht. Eher eine kuratierte Erinnerung daran, dass diese Technologie überhaupt eine Vergangenheit hat.

Das ist eine merkwürdige Lage für etwas, das still und leise den Großteil der weltweiten Daten hält.

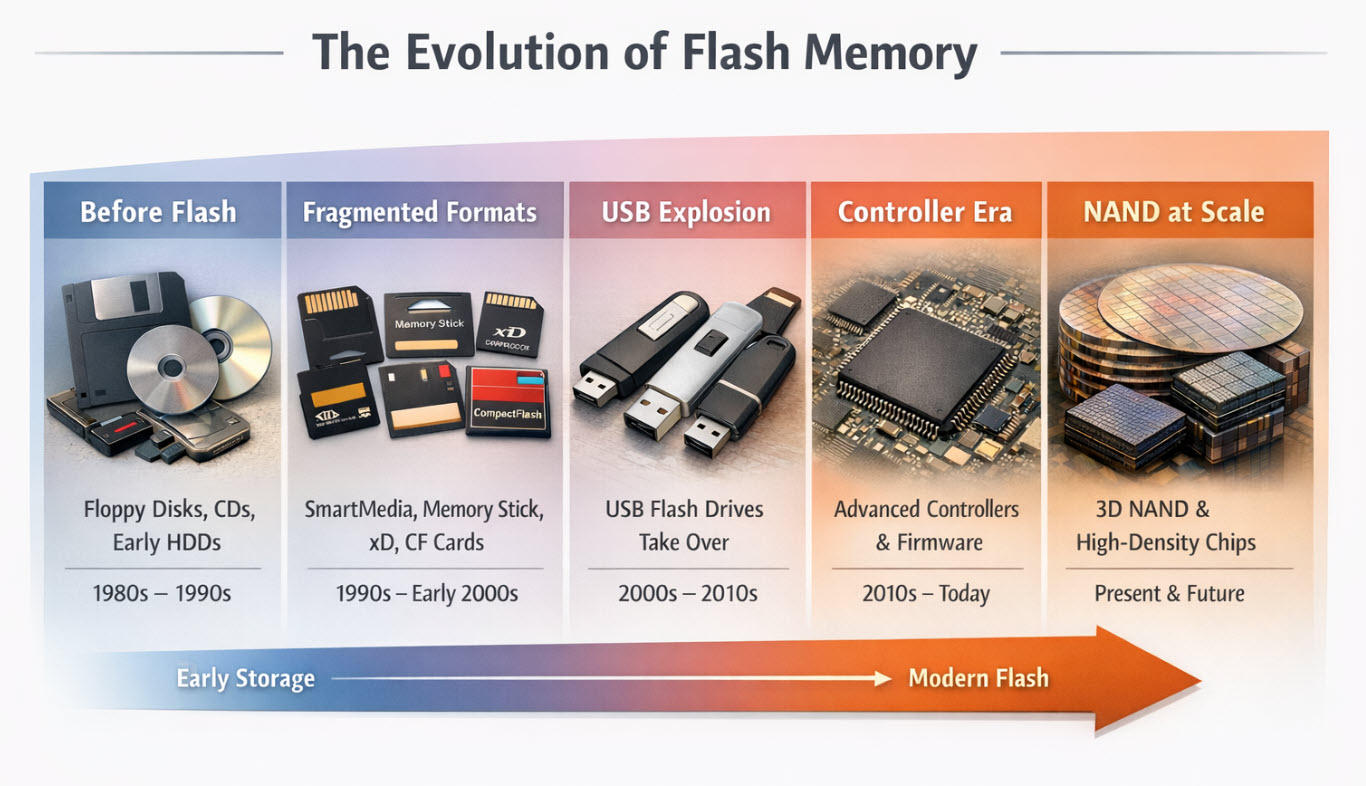

Flash-Speicher steckt heute unter allem – USB-Sticks, SD-Karten, SSDs, eingebetteten Systemen – und trotzdem gibt es fast keinen physischen Nachweis darüber, wie sich das Ganze entwickelt hat. Kein zentrales Archiv. Keine allgemein anerkannte Sammlung. Keinen Ort, an dem man die Entwicklung von frühen Wechselmedien bis zu den controllergesteuerten Speichersystemen nachvollziehen kann, auf die wir uns heute verlassen. Für eine so wichtige Technologie ist diese Lücke kaum zu übersehen, sobald man einmal danach sucht. Wer erst einmal einen Schritt zurückgehen und verstehen will, wie Daten auf diesen Geräten überhaupt gespeichert werden, sollte sich ansehen, was das USB-Massenspeichergerät-Protokoll eigentlich ist, bevor es tiefer in die zugrunde liegende Architektur geht.

Und je länger man darüber nachdenkt, desto unangenehmer wird es. Denn das ist nicht nur eine Lücke in der Bewahrung – es ist ein strukturelles Problem der Technologie selbst. Flash-Speicher ist sehr gut darin, Daten zu halten, aber er ist offenbar nicht besonders gut darin, seine eigene Geschichte zu bewahren.

Im Zentrum des Ganzen steht NAND-Flash – die Kerntechnologie hinter nahezu jedem modernen Speichergerät. Es ist gerade nicht nur ein Teil der Diskussion, es ist die Diskussion. Lieferengpässe, Skalierungsgrenzen, Controller-Komplexität, Enterprise-Nachfrage – NAND taucht in Branchenberichten, Earnings Calls und Infrastrukturplanungen in einer Form auf, wie es vor zehn Jahren noch nicht der Fall war.

Und dieser Druck lässt nicht nach. Wenn überhaupt, nimmt er weiter zu.

Der Aufstieg der künstlichen Intelligenz – insbesondere der Übergang von heutigen großen Modellen hin zu dem, was viele als Artificial General Intelligence (AGI) bezeichnen – erzeugt eine völlig neue Klasse von Datenbedarf. AGI meint, ganz einfach gesagt, Systeme, die über viele verschiedene Aufgaben hinweg auf menschenähnlichem Niveau denken, lernen und sich anpassen können, statt nur auf enge Spezialfunktionen beschränkt zu sein. Ob dieser Zeitplan bald Realität wird oder nicht – die Richtung ist klar: mehr Modelle, mehr Daten, mehr Checkpoints, mehr Speicherebenen, die zunehmend komplexe Systeme versorgen.

Flash-Speicher sitzt genau in der Mitte dieser Pipeline.

Trainingsdatensätze, Modellgewichte, Inference-Caching, Edge-Deployment – das sind keine theoretischen Workloads. Das passiert bereits jetzt, und all das hängt von schnellem, dichtem und zuverlässigem Speicher ab. NAND ist nicht nur für Verbrauchergeräte grundlegend geworden, sondern für die Infrastruktur, die die nächste Phase des Computings prägt.

Und genau dadurch wird die Lage noch ungewöhnlicher.

Genau in dem Moment, in dem Flash-Speicher zu einer der kritischsten Technologien der Welt wird, gehört er weiterhin zu den am wenigsten bewahrten.

Wenn es also ein echtes Flash-Speicher-Museum gäbe – etwas Größeres als nur eine kleine Firmenausstellung – was würde man dort eigentlich sehen?

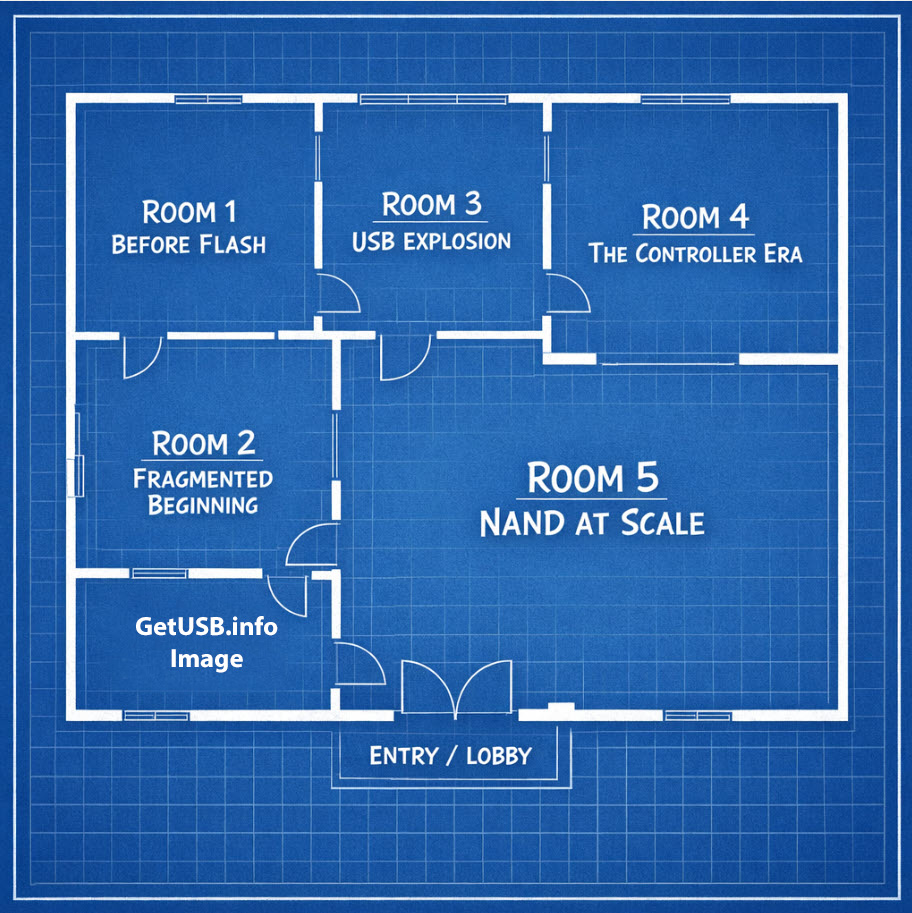

Ein Rundgang durch ein Flash-Speicher-Museum

Wenn es ein echtes Flash-Speicher-Museum gäbe, würde es sich nicht wie eine Zeitleiste an der Wand anfühlen, mit Jahreszahlen und Produktstarts. Es würde sich eher anfühlen wie ein Spaziergang durch die Schichten, aus denen Speicher tatsächlich besteht, wobei jeder Raum größer oder kleiner wäre – je nachdem, wie viel er wirklich zum fertigen Gerät beiträgt.

Nicht alle Teile des Flash-Speichers haben dasselbe Gewicht. Manche sind sichtbar, aber einfach. Andere sind vollständig verborgen und tragen den Großteil von Kosten, Risiko und Entwicklungsaufwand. Würde man das physisch darstellen, würden die Proportionen eine ganz andere Geschichte erzählen, als die meisten erwarten.

Der Museumsgrundriss, der die wahre Geschichte erzählt

Raum 1 – Vor Flash (Kleiner Raum – ca. 5 %)

Man würde in einem kleineren Raum beginnen, fast so unauffällig, dass man ihn leicht übersehen könnte, wenn man nicht aufpasst.

Disketten, optische Medien, vielleicht ein paar frühe Festplatten. Physischer Speicher, den man in die Hand nehmen, anschauen und ohne viel Erklärung verstehen kann. Daten hatten einen Ort, auf den man zeigen konnte. Wenn etwas ausfiel, dann meist auf eine Weise, die man sehen oder hören konnte.

Darin liegt ein gewisser Trost.

Dieser Raum ist wichtig, weil er die Ausgangsbasis setzt. Er erinnert daran, dass Speicher einmal greifbar war und in vielen Fällen überraschend langlebig, wenn man ihn richtig behandelte. Aber gemessen daran, wie moderne Flash-Geräte gebaut sind und was sie kosten, nimmt dieser Teil der Geschichte heute nicht mehr viel Raum ein. Er ist Kontext, nicht Beitrag.

Raum 2 – Der fragmentierte Anfang (Mittlerer Raum – ca. 10-15 %)

Im nächsten Raum wird es etwas voller und auch etwas unordentlicher.

Plötzlich sieht man SmartMedia-Karten, Memory Stick, xD-Picture Card – Formate, die einem bekannt vorkommen, wenn man lange genug dabei war, die aber gleichzeitig ein wenig losgelöst voneinander wirken. Unterschiedliche Formen, unterschiedliche Anschlüsse, unterschiedliche Annahmen darüber, wie der Speicher genutzt werden sollte.

Auf den ersten Blick wirkt das wie ein einfacher Formatkrieg, aber genau das war es nicht wirklich. Unter diesen Bauformen steckten reale Grenzen, die mit Controller-Fähigkeiten, NAND-Dichte und der Frage zusammenhingen, wie sich Daten zuverlässig verwalten ließen. Einige Formate stießen früh an Skalierungsgrenzen. Andere waren zu stark kontrolliert, um breite Akzeptanz zu finden. Und manche wurden schlicht zu teuer, sobald bessere Optionen auftauchten.

Sie verschwanden nicht, weil die Leute sie nicht mehr mochten. Sie verschwanden, weil sie nicht mithalten konnten.

Dieser Raum nimmt mehr Platz ein, weil er für eine Phase steht, in der die Branche vieles noch herausfinden musste – und dieser Prozess war nicht billig. In den Formaten, die es nicht geschafft haben, steckt eine Menge Entwicklungsarbeit.

Raum 3 – Die USB-Explosion (Großer Raum – ca. 20-25 %)

Dann betritt man einen Raum, der sich spürbar öffnet.

Hier übernehmen USB-Sticks die Führung, und alles beginnt einheitlicher zu wirken. Die Formen werden einfacher, die Schnittstellen standardisieren sich, und die Idee von portablem Speicher hört auf, ein Nischenfall zu sein, sondern wird zu etwas, das man fast schon selbstverständlich erwartet.

Interessant ist, dass die Dinge außen einfacher aussehen, während sie innen genau an diesem Punkt komplizierter werden. Controller werden leistungsfähiger, NAND wird dichter, und die Fertigung skaliert in einer Weise, die Flash zu einer Commodity macht.

Hier verschwindet Flash auch in den Hintergrund. Es ist nicht mehr das eigentliche Merkmal – es ist einfach da und erledigt seinen Job. Die Leute hören auf, darüber nachzudenken, wie es funktioniert, und beginnen stattdessen davon auszugehen, dass es immer da sein wird, wenn sie es brauchen.

Aus Kostensicht ist dieser Raum beträchtlich, weil er den Übergang zur Massenproduktion und weltweiten Verbreitung widerspiegelt. Hier wird Flash Teil des Alltags-Computings und nicht mehr etwas, das man nur gezielt kaufen geht.

Raum 4 – Die Controller-Ära (Größter Raum – ca. 30-40 %)

Irgendwann betritt man den größten Raum, und wenn man Flash-Speicher vorher noch nicht wirklich verstanden hat, beginnt es genau hier langsam Klick zu machen.

Denn genau hier passiert die eigentliche Arbeit.

In diesem Raum sieht man nicht einfach nur Chips – man sieht die Logik dahinter. Den Controller, die Firmware, die Zuordnung zwischen dem, was das System zu schreiben glaubt, und dem, was das NAND tatsächlich verkraften kann. Das ist der Teil des Systems, den die meisten nie zu Gesicht bekommen, der aber im Hintergrund ständig übersetzt, korrigiert und Entscheidungen trifft.

Wichtig ist zu verstehen: Rohes NAND ist für sich genommen nicht besonders zuverlässig. Zellen verschleißen, Bits driften, Blöcke werden schlecht. Ohne Verwaltung wäre es nicht lange brauchbar. Der Controller ist das, was aus diesem instabilen Medium etwas macht, das sich wie stabiler Speicher verhält.

Er entscheidet, wohin Daten gehen, wie lange sie dort bleiben, wann sie verschoben werden müssen und wie Fehler auf dem Weg dorthin behandelt werden. Genau hier liegt auch der Grund, warum zwei Geräte, die auf dem Papier identisch aussehen, sich in der Praxis sehr unterschiedlich verhalten können.

Dieser Raum ist groß, weil die Kosten groß sind – nicht nur bei den Komponenten, sondern auch bei Entwicklung, Validierung und langfristiger Zuverlässigkeit. Vieles von dem, was ein Speicherprodukt besser macht als ein anderes, lebt genau hier, auch wenn es auf keinem Datenblatt auftaucht.

Raum 5 – NAND im großen Maßstab (Massiver Raum – ca. 40-50 %)

Und dann betritt man den letzten Raum, und der ist alles andere als subtil.

Dieser Bereich wird von der physischen Realität des NAND selbst dominiert. Wafer, gestapelte Schichten, immer dichtere Zellstrukturen, die bis an ihre Grenzen getrieben werden. Hier sitzt der größte Teil der Kosten, und das sieht man sofort.

Was in diesem Raum deutlich wird: Alles andere existiert letztlich, um das zu stützen, was hier passiert. Je dichter NAND wird, desto empfindlicher wird es auch. Die Fehlerraten steigen. Die Datenhaltung wird anspruchsvoller. Die Fehlertoleranz schrumpft.

Also muss der Controller härter arbeiten. Die Firmware muss mehr ausgleichen. Das ganze System wird zu einem Balanceakt zwischen Dichte, Leistung und Zuverlässigkeit.

Und hier kommt auch der aktuelle Moment in den Fokus. Enterprise-Speicher, Rechenzentren, KI-Workloads – all das hängt davon ab, NAND weiter auszureizen und es trotzdem vorhersehbar arbeiten zu lassen.

Und das wird schwerer, nicht leichter.

Was die Räume tatsächlich erzählen

Wenn man einen Schritt zurücktritt und sich den Grundriss als Ganzes ansieht, erzählen die Proportionen eine Geschichte, mit der die meisten nicht rechnen.

Die Teile, mit denen man direkt zu tun hat – der Anschluss, die Bauform, sogar die Marke – nehmen vergleichsweise wenig Platz ein. Der Großteil des Systems lebt an Orten, die man nicht sieht, getrieben von physikalischen Grenzen und der Logik, die nötig ist, um diese Grenzen zu umgehen.

Und genau das macht die Idee, Flash-Speicher zu bewahren, so kompliziert.

Man kann Geräte hinter Glas stellen. Man kann Formate und Zeitleisten beschriften. Aber die wichtigsten Teile – das Verhalten des Controllers, die Entscheidungen der Firmware, die Art, wie Daten im Laufe der Zeit verwaltet werden – bleiben nicht wirklich lange genug stehen, um im klassischen Sinn bewahrt zu werden.

Sie entwickeln sich weiter, werden ersetzt und verschwinden schließlich zusammen mit der Hardware, von der sie abhingen.

Und genau dadurch wirkt die Idee eines Flash-Speicher-Museums ein wenig seltsam, wenn man länger darüber nachdenkt.

Denn selbst wenn man eines bauen würde, wären die wichtigsten Teile nicht die, die sich am leichtesten erhalten lassen.

Autor & Transparenz zum Inhalt

Dieser Artikel begann mit einer einfachen Beobachtung des Autors: Für eine Technologie, die fast alle modernen Daten speichert, besitzt Flash-Speicher so gut wie kein formelles Archiv und keinen öffentlichen Nachweis seiner eigenen Entwicklung. Konzept, Richtung und technische Perspektive beruhen auf langjähriger praktischer Erfahrung im Umgang mit USB-Speichersystemen, Controller-Verhalten und dem Einsatz von Flash-Speicher in kommerziellen und industriellen Umgebungen.

Der Autor ist seit 2004 im Bereich USB und Flash-Speicher tätig und hatte aus erster Reihe Einblick darin, wie sich Speichergeräte entwickelt haben – von frühen Wechselmedien bis hin zu modernen controllergesteuerten Systemen. Rückblickend ist es nicht unvernünftig zu sagen, dass jemand schon vor Jahren ein echtes Archiv oder Museum hätte aufbauen können, wenn der Branche bewusst gewesen wäre, wie wenig davon erhalten bleiben würde. Stattdessen wurde ein Großteil dieser Geschichte verstreut, ersetzt oder still und leise verloren, während jede neue Technologiegeneration nach vorne ging.

Bei der Erstellung dieses Artikels wurden KI-Tools eingesetzt, um Struktur, Fluss und allgemeine Lesbarkeit zu unterstützen. Alle grundlegenden Ideen, technischen Einsichten und Schlussfolgerungen wurden jedoch vom Autor entwickelt und geprüft, um Genauigkeit und Relevanz sicherzustellen.

Die in diesem Artikel verwendeten Bilder sind keine Stockfotos. Es handelt sich um visuelle Darstellungen, die mit Unterstützung von KI-Tools erstellt wurden und auf den im Inhalt beschriebenen Szenarien und Konzepten basieren. Diese Visualisierungen sollen Ideen veranschaulichen, die sich mit klassischer Fotografie nur schwer erfassen lassen – insbesondere wenn es um interne Komponenten, historische Formate oder abstraktes Systemverhalten geht.