KI-Infrastruktur hat die unangenehme Eigenschaft, Grenzen sichtbar zu machen, an die die meisten Systeme nie stoßen.

In den früheren Beiträgen haben wir uns angesehen, wie High Bandwidth Memory für KI-Workloads Daten so nah wie möglich an der GPU hält und wie Storage Class Memory zwischen DRAM und NAND hilft, die Lücke zwischen aktivem Arbeitsspeicher und klassischem Flash-Speicher zu glätten. Beide Ebenen existieren, weil das System es sich nicht leisten kann zu warten – selbst nicht für kurze Zeiträume -, ohne dabei Effizienz zu verlieren.

Aber es gibt noch eine andere Richtung, in die sich die Branche bewegt, und dabei geht es nicht darum, einen völlig neuen Speichertyp einzuführen.

Stattdessen nimmt man etwas, das bereits existiert – NAND-Flash – und drängt es in eine Rolle, für die es ursprünglich gar nicht gedacht war.

Genau hier beginnt die Idee von High Bandwidth Flash ins Spiel zu kommen.

Das Problem, das NAND nie lösen sollte

NAND-Flash wurde schon immer rund um eine einfache Idee aufgebaut: große Datenmengen effizient speichern und sie bei Bedarf wieder abrufen.

Für die meisten Workloads funktioniert dieses Modell vollkommen gut. Daten liegen im Speicher, das System fordert sie an, und die SSD liefert sie schnell genug, sodass die Verzögerung kaum jemand bemerkt.

KI-Workloads verändern diese Dynamik.

Statt gelegentlicher Lese- und Schreibvorgänge ziehen diese Systeme fortlaufend Daten parallel herein, oft über Tausende Threads hinweg, und sie haben nur sehr wenig Toleranz für Unregelmäßigkeiten bei der Bereitstellung. Es geht nicht nur um Geschwindigkeit als isolierten Wert, sondern darum, einen konstanten Datenfluss aufrechtzuerhalten, der die Rechenseite vollständig auslastet.

Genau dort beginnt klassisches NAND-Verhalten an seine Grenzen zu stoßen.

Selbst leistungsstarke NVMe-Laufwerke mit tiefen Warteschlangen und beeindruckenden Durchsatzwerten arbeiten immer noch innerhalb eines Speichermodells, das von Aktivitätsschüben ausgeht – nicht von einem kontinuierlichen, speicherähnlichen Zugriffsfluss.

Also lautet die Frage: Was passiert, wenn man NAND nicht mehr wie Speicherplatz behandelt, sondern eher wie einen Teil des Arbeitsspeichersystems?

Was „High Bandwidth Flash“ eigentlich bedeutet

High Bandwidth Flash ist kein formaler Standard und auch keine einzelne Produktkategorie.

Am besten versteht man es als eine architektonische Richtung, und genau dort beginnt es sich von dem zu unterscheiden, was wir bei High Bandwidth Memory behandelt haben.

High Bandwidth Memory ist weiterhin echter Arbeitsspeicher. Es ist DRAM, der so aufgebaut und positioniert wird, dass er extrem schnellen Zugriff liefern kann, weil er physisch nah am Prozessor sitzt. Der ganze Sinn von HBM liegt in Nähe und geringerer Latenz – Daten so nah wie möglich an die Recheneinheit zu bringen, damit nahezu sofort darauf zugegriffen werden kann.

High Bandwidth Flash löst ein anderes Problem. Es akzeptiert, dass NAND weiter entfernt im System sitzt und eine höhere Latenz mitbringt, und konzentriert sich stattdessen darauf, wesentlich größere Datenmengen parallel zu bewegen, sodass diese Distanz weniger ins Gewicht fällt.

Einfach gesagt: Bei HBM geht es darum, Arbeitsspeicher schneller zu machen, indem man ihn näher heranbringt. Bei High Bandwidth Flash geht es darum, Speicher schneller wirken zu lassen, indem man verändert, wie darauf zugegriffen wird.

Diese Unterscheidung ist wichtig, denn das Ziel ist hier nicht, NAND in DRAM zu verwandeln. Das Ziel ist, NAND in Situationen nützlich zu machen, in denen klassischer Speicher das System sonst ausbremsen würde.

Die Veränderung passiert auf Systemebene, nicht nur auf Ebene des Speichermediums.

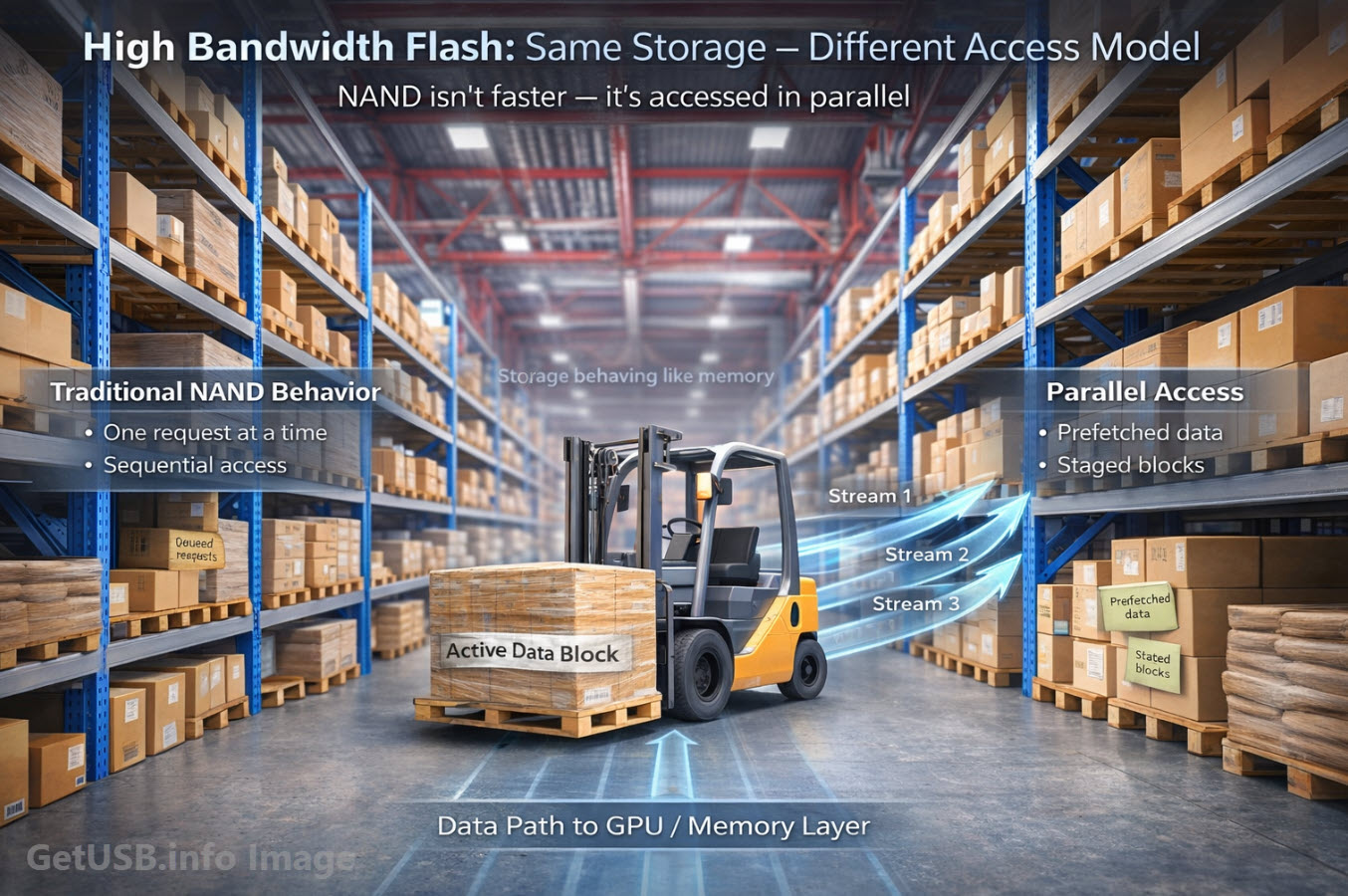

Statt einer einzelnen SSD, die Anfragen auf traditionelle Weise bedient, sieht man immer häufiger viele NAND-Kanäle, die parallel arbeiten, Controller, die eher auf Gleichzeitigkeit als nur auf Kapazität ausgelegt sind, breitere Datenpfade über PCIe-Gen5- und Gen6-Schnittstellen hinweg sowie Software-Schichten, die Daten vorwegnehmen und bereitstellen, bevor sie überhaupt angefordert werden.

Zusammengenommen beseitigen diese Änderungen die inhärente Latenz von NAND nicht, aber sie verringern, wie oft diese Latenz im System zum begrenzenden Faktor wird.

Eine andere Art, über Bandbreite nachzudenken

Wenn Menschen „hohe Bandbreite“ hören, denken sie meist zuerst an rohe Geschwindigkeit.

In diesem Zusammenhang geht es bei Bandbreite aber eher darum, wie viele Daten gleichzeitig bewegt werden können und wie konstant diese Bewegung aufrechterhalten werden kann.

KI-Workloads brauchen nicht nur schnellen Zugriff, sie brauchen vorhersehbaren Zugriff im großen Maßstab.

Wenn ein GPU-Cluster Daten ungleichmäßig abruft, können schon kleine Schwankungen dazu führen, dass Teile des Systems stehen bleiben. Multipliziert man das über Hunderte oder Tausende Knoten hinweg, werden diese Ineffizienzen irgendwann deutlich genug, dass man sie nicht mehr ignorieren kann.

High Bandwidth Flash ist ein Versuch, genau das zu glätten – nicht indem die Eigenschaften von NAND verschwinden, sondern indem man es mit genügend Parallelität und Intelligenz umgibt, sodass diese Eigenschaften für das Gesamtsystem weniger wichtig werden.

Die Lagerhaus-Analogie weitergedacht

Wenn wir beim gleichen Lagerhausmodell aus den früheren Artikeln bleiben, dann war NAND schon immer die eigentliche Lagerfläche.

Dort liegt alles, geordnet in Reihen und Regalen, optimiert auf Dichte und Effizienz statt auf sofortigen Zugriff.

DRAM ist die Laderampe, wo die aktive Arbeit passiert. SCM ist der Bereitstellungsbereich direkt dahinter.

High Bandwidth Flash verändert die Art, wie dieses Lagerhaus arbeitet.

Statt dass ein einzelner Mitarbeiter durch die Gänge läuft und Artikel nacheinander zusammensucht, sind jetzt mehrere Laderampen gleichzeitig geöffnet, mehrere Gabelstapler bewegen sich parallel, und Artikel werden auf Basis dessen vorpositioniert, was das System als Nächstes brauchen wird.

Das Lagerhaus selbst hat sich nicht grundlegend verändert, aber die Art, wie darauf zugegriffen wird, schon.

Man verwandelt das Lagerhaus nicht in die Laderampe – man sorgt nur dafür, dass sich das Lagerhaus so verhält, als wäre es ihr viel näher.

Wie das in der Praxis aufgebaut wird

Das meiste, was High Bandwidth Flash ermöglicht, kommt nicht aus dem NAND selbst, sondern aus den Schichten darum herum.

Controller spielen heute eine größere Rolle dabei, wie Daten verteilt werden, und konzentrieren sich auf parallele Abläufe über mehrere NAND-Dies und Kanäle hinweg, statt einfach nur Kapazität und Verschleiß zu verwalten. Gleichzeitig wächst die Bandbreite der Schnittstellen weiter, wodurch diese Systeme mehr Spielraum bekommen, Daten zu bewegen, ohne durch den Bus ausgebremst zu werden.

Den größten Unterschied macht aber, wie die Software mit der Hardware zusammenarbeitet.

Daten werden nicht mehr erst dann geholt, wenn sie angefordert werden. Sie werden vorhergesagt, bereitgestellt, zwischengespeichert und so organisiert, dass es zu dem passt, wie KI-Workloads tatsächlich arbeiten. Das bedeutet, Zugriffsmuster vorwegzunehmen, häufig genutzte Daten näher an die Spitze des Stacks zu bringen und zu minimieren, wie oft das System auf langsamere Pfade zurückfallen muss.

All das macht NAND nicht zu echtem Arbeitsspeicher, aber es erlaubt NAND, aktiver am Speichersystem teilzunehmen als früher.

Was es trotzdem nicht ist

Bei all diesem Fortschritt ist es wichtig, die Erwartungen auf dem Boden zu halten.

High Bandwidth Flash macht NAND nicht zu einem Äquivalent von DRAM. Es ist weiterhin blockbasiert, hat weiterhin eine höhere Latenz als jede Form von echtem Arbeitsspeicher und ist weiterhin stark auf Controller und Software angewiesen, um in anspruchsvollen Umgebungen gut zu funktionieren.

Diese Einschränkungen verschwinden nicht – sie werden durch Systemdesign lediglich besser kontrolliert.

Wo das in KI-Infrastrukturen hineinpasst

In realen Deployments taucht High Bandwidth Flash in Systemen auf, die extrem große Datensätze verarbeiten müssen, ohne alles in teure Speicherebenen zu drücken.

Praktisch sieht das so aus, dass ein System sich viel aktiver auf NAND stützt als früher – nicht nur als Ort, an dem Daten abgelegt werden, sondern als Teil des aktiven Datenpfads, der Rechenressourcen kontinuierlicher versorgt.

In großen Inferenzumgebungen etwa überschreiten Modelle und Kontextdaten oft das, was realistisch in DRAM passt. Statt alles zwanghaft in den Arbeitsspeicher zu pressen, verlässt sich das System auf schnellen, hochdurchsatzfähigen Zugriff auf NAND, sodass Daten zügig genug hereingestreamt werden können, dass es sich eher wie eine Erweiterung des Arbeitsspeichers als wie klassischer Speicher anfühlt.

In Trainingsumgebungen, in denen Datensätze ständig erneut durchlaufen und parallel verarbeitet werden, verschiebt sich das Ziel hin zu einem gleichmäßigen Fluss statt zu isolierten Leistungsspitzen. High Bandwidth Flash unterstützt das, indem mehrere Datenpfade gleichzeitig aktiv gehalten werden, wodurch die Wahrscheinlichkeit sinkt, dass eine einzelne Anfrage zum Flaschenhals wird.

Selbst in verteilten NVMe-Fabric-Systemen bleibt die Idee dieselbe. Daten sind über viele Geräte und Knoten verteilt, werden aber koordiniert so angesprochen, dass Durchsatz und Verfügbarkeit stärker betont werden als bloße Speicherkapazität. NAND erfüllt also immer noch denselben grundlegenden Zweck, aber die Art, wie das System damit umgeht, ist deutlich dynamischer geworden als früher.

Das Endergebnis ist, dass NAND aufhört, sich wie eine weit entfernte Schicht am unteren Ende des Stacks anzufühlen, und zunehmend so wirkt, als wäre es Teil des aktiven Systems – auch wenn es die Leistungsmerkmale von Arbeitsspeicher nie vollständig erreicht.

Warum diese Richtung wichtig ist

Wenn man einen Schritt zurücktritt und betrachtet, was in allen drei Artikeln passiert, beginnt ein Muster sichtbar zu werden.

HBM bringt den Arbeitsspeicher näher an die Recheneinheit. SCM verkleinert die Lücke zwischen Arbeitsspeicher und Speicher. High Bandwidth Flash schiebt Speicher näher an den Arbeitsspeicher heran.

Alles läuft auf dasselbe Ziel hinaus: die Distanz zu verkürzen, die Daten zurücklegen müssen, und die Zeit zu verkürzen, die das System auf sie warten muss.

Zurück zum größeren Gesamtbild

NAND verschwindet nicht.

Im Gegenteil – es wird sogar wichtiger, weil die Gesamtmenge an Daten, die diese Systeme brauchen, weiter wächst.

Was sich verändert, ist die Art, wie NAND eingesetzt wird.

Es ist nicht mehr nur eine passive Schicht ganz unten im Stack. Es wird weiter nach oben gezogen, enger integriert und dazu gebracht, sich auf eine Weise zu verhalten, die immer stärker an Arbeitsspeicher erinnert – auch wenn es das nie vollständig wird.

Genau auf diese Verschiebung haben wir im ursprünglichen Beitrag hingewiesen: Die Branche hat NAND nicht ersetzt, sie hat darum herum gebaut.

Was als Nächstes kommt

Von hier aus entwickelt sich der Stack in beide Richtungen weiter.

Oben wird Arbeitsspeicher schneller und spezialisierter. Unten wird Speicher intelligenter und stärker integriert. Und irgendwo dazwischen wird die Linie zwischen beidem immer schwerer zu ziehen.

Im nächsten Beitrag schauen wir uns an, wie KI-Systeme Arbeitsdaten in Echtzeit handhaben und warum Konzepte wie Kontext und KV-Cache zunehmend beeinflussen, wie Arbeitsspeicher und Speicher gemeinsam entworfen werden.

Redaktioneller Hinweis

Die Perspektive, Ausrichtung und technische Einordnung dieses Artikels wurden vom Autor vorgegeben – auf Grundlage der im Beitrag behandelten Themen und der breiteren Diskussion darüber, wie NAND in KI-Infrastrukturen näher an die Speicherschicht herangerückt wird.

KI wurde als Schreibassistenz verwendet, um Rhythmus, Satzfluss und strukturelle Organisation zu unterstützen, aber die thematische Richtung, die Vergleiche und die endgültige redaktionelle Absicht wurden vom Autor festgelegt.

Das begleitende Bild wurde ebenfalls mit KI erstellt – nicht als generisches Stockmotiv, sondern als gezielt entwickelte Illustration, um artikelspezifische Konzepte sichtbar zu machen, die sich mit herkömmlichen Bildern nur schwer vermitteln lassen – insbesondere die Idee, dass NAND-Flash sich innerhalb moderner Datenarchitekturen eher wie eine aktive, arbeitsspeichernahe Ebene verhält.

Alle Inhalte wurden vor der Veröffentlichung vom Autor geprüft, überarbeitet und freigegeben.