Wenn man sich einmal genauer ansieht, wie KI-Systeme tatsächlich aufgebaut sind, kommt man ganz natürlich zu einem Schluss, und fairerweise muss man sagen: Auf den ersten Blick klingt er völlig vernünftig.

Wenn NAND für bestimmte Teile der Arbeitslast zu langsam ist und selbst fortschrittliche Flash-Architekturen noch genug Verzögerung mitbringen, um ins Gewicht zu fallen, dann scheint die offensichtliche Antwort zu sein, einfach mehr DRAM hinzuzufügen. Schließlich war DRAM schon immer die schnelle Ebene. Dort liegen aktive Daten, es reagiert schnell, und seit Jahrzehnten ist es genau der Teil des Systems, auf den man sich verlässt, wenn man nicht möchte, dass der Prozessor untätig herumsteht und darauf wartet, dass etwas ankommt.

Die Annahme liegt also nahe: Wenn Geschwindigkeit das Problem ist, dann erweitert man einfach das Schnellste, das man hat.

Diese Logik funktioniert ziemlich gut – bis KI ins Spiel kommt und DRAM in eine Rolle drängt, für die es eigentlich nie wirklich gedacht war. Das Problem ist nicht, dass DRAM plötzlich langsam geworden wäre oder veraltet oder irgendwie weniger nützlich als früher. Das Problem ist, dass KI-Workloads von ihm inzwischen deutlich mehr verlangen, als nur als schnelle Arbeitsschicht zwischen Recheneinheit und Speicher zu dienen.

Für den größeren Rahmen hinter diesem Wandel knüpft dieser Artikel direkt an den Hauptbeitrag der Serie an: NAND verschwindet nicht, aber KI-Server sind heute auf mehr als nur Flash angewiesen.

DRAM wurde für Geschwindigkeit gebaut, nicht dafür, das gesamte System zu tragen

Das Erste, was man verstehen muss, ist, dass DRAM schon immer auf Geschwindigkeit und Reaktionsfähigkeit optimiert war – nicht darauf, riesige Datenmengen im großen Maßstab zu halten. Im klassischen Computing war dieser Unterschied selten ein Problem, weil die meisten Workloads eine ziemlich klare Trennung zwischen aktiven Daten und gespeicherten Daten hatten. Das System hielt das, was es sofort brauchte, im Speicher, holte den Rest bei Bedarf aus dem Storage, und diese Übergabe funktionierte meist gut genug, dass kaum jemand weiter darüber nachdachte.

KI verschiebt dieses Gleichgewicht ziemlich drastisch. Statt nur mit überschaubaren aktiven Datenblöcken zu arbeiten und dann weiterzugehen, greifen KI-Modelle große Datensätze immer wieder auf, bewegen Informationen parallel und halten einen deutlich größeren Teil des Working Sets viel länger in Reichweite der Compute-Ebene. Das bedeutet, DRAM soll nicht mehr einfach nur die aktuelle Aufgabe halten. Es soll helfen, einen riesigen und ständig wechselnden Datenkörper bereitzuhalten, den das System möglichst jederzeit in der Nähe haben will.

Das ist eine völlig andere Aufgabe.

Und genau deshalb sind Technologien oberhalb und rund um DRAM wichtiger geworden. Im früheren Artikel über High Bandwidth Memory und warum KI darauf angewiesen ist lag der Fokus darauf, eine kleinere Menge besonders kritischer Daten extrem nah an den Prozessor zu bringen, damit die GPU ständig versorgt bleibt. Dieser Artikel macht deutlich, dass Nähe entscheidend ist, aber er zeigt nebenbei auch schon das nächste Problem, denn sobald das Working Set über diese unmittelbare Schicht hinauswächst, muss das System immer noch entscheiden, wo alles andere eigentlich leben soll.

Die erste Wand sind die Kosten – und die tauchen sehr schnell auf

Einer der Gründe, warum viele Leute die Idee „einfach mehr DRAM“ mögen, ist, dass sie sauber und direkt klingt. In der Praxis wird das sehr schnell teuer. DRAM ist preislich schlicht nicht mit NAND vergleichbar, und sobald Systeme in KI-Dimensionen wachsen, spricht man nicht mehr davon, einem Server ein bisschen zusätzlichen Speicher zu geben. Man spricht über Hunderte Gigabyte, manchmal deutlich mehr, verteilt über viele Nodes, Racks und Cluster.

Ab diesem Punkt fühlt sich DRAM nicht mehr wie ein Performance-Upgrade an, sondern eher wie eine infrastrukturelle Last. Die Kostenkurve steigt nicht langsam an. Sie klettert schnell genug, dass die Idee, mit DRAM jedes Problem der Datennähe zu lösen, unter ihren eigenen wirtschaftlichen Bedingungen zu zerbrechen beginnt.

Das ist einer der Gründe, warum der Speicher-Stack tiefer statt einfacher wird. Die Branche entfernt sich nicht von DRAM, weil es seinen Wert verloren hätte. Sie entfernt sich von der Annahme, dass DRAM allein jede latenzkritische Herausforderung im KI-Maßstab lösen kann.

Die zweite Wand ist Energie – und dieses Problem schläft nie

Selbst wenn sich die Kosten leichter rechtfertigen ließen, stößt DRAM noch auf ein weiteres Problem, das sich ab einer bestimmten Systemgröße nicht mehr ignorieren lässt, und das ist der Stromverbrauch. DRAM muss dauerhaft mit Energie versorgt werden, um seinen Zustand zu erhalten. Das gehört nun einmal zur Technik. Je mehr man also davon einbaut, desto mehr Energie verbraucht das System allein dafür, dass die Daten dort einfach nur bereitliegen.

In kleineren Umgebungen mag dieser Mehraufwand akzeptabel erscheinen. In dichten KI-Systemen, die rund um die Uhr laufen, wird daraus schnell ein ernstes Betriebsproblem. Mehr DRAM bedeutet mehr Stromaufnahme, mehr Wärme, mehr Kühlung und mehr Druck auf das gesamte Plattformdesign. Plötzlich geht es bei der Entscheidung nicht mehr nur um Speicherkapazität. Es geht um thermische Grenzen, Effizienz im Rechenzentrum und darum, ob die restliche Infrastruktur die Kosten dafür tragen kann, so viel aktiven Speicher permanent am Leben zu halten.

Genau hier wird auch die Rolle von Zwischenschichten viel nachvollziehbarer. Im vorherigen Teil über Storage Class Memory zwischen DRAM und NAND ging es nicht darum, DRAM zu ersetzen, sondern einen Teil des Drucks von ihm zu nehmen, indem eine Schicht eingeführt wird, die mehr Daten näher an Compute hält, ohne alles in die teuerste und stromhungrigste Ebene zu zwingen.

Dann gibt es noch die physische Realität der Nähe

Es gibt noch einen weiteren Grund, warum sich DRAM in KI-Systemen nicht unbegrenzt gut skalieren lässt, und der hat weniger mit Budget als mit Physik zu tun. DRAM ist unter anderem deshalb wertvoll, weil es relativ nah am Prozessor sitzt. Je näher der Speicher an der Recheneinheit liegt, desto geringer ist in der Regel die Latenz und desto reaktionsfreudiger wirkt das Gesamtsystem. Aber Nähe ist nichts, was man ohne Folgen einfach endlos ausbauen kann.

Es gibt physische Grenzen dafür, wie viel Speicher in der Nähe einer CPU oder GPU platziert werden kann, bevor Layout-Komplexität, Leitungslängen, Signalintegrität und Packaging-Beschränkungen anfangen, gegen einen zu arbeiten. Genau deshalb ist fortschrittliches Memory-Packaging überhaupt erst entstanden. HBM existiert, weil die klassische Platzierung von DRAM nur bis zu einem gewissen Punkt funktioniert, und sobald die Compute-Seite schnell genug wird, spielen diese Distanzen und Verbindungswege eine größere Rolle als früher.

Aber auch HBM ist keine vollständige Antwort auf die Kapazitätsfrage. Es bietet enorme Bandbreite, aber kein unbegrenztes Volumen. Das System lebt also in einem ständigen Balanceakt zwischen dem, was sehr nah platziert werden kann, und dem, was weiter entfernt liegen muss. KI-Workloads belasten genau diesen Balanceakt deutlich stärker, als es konventionelle Systeme je getan haben.

KI macht kleine Verzögerungen teuer

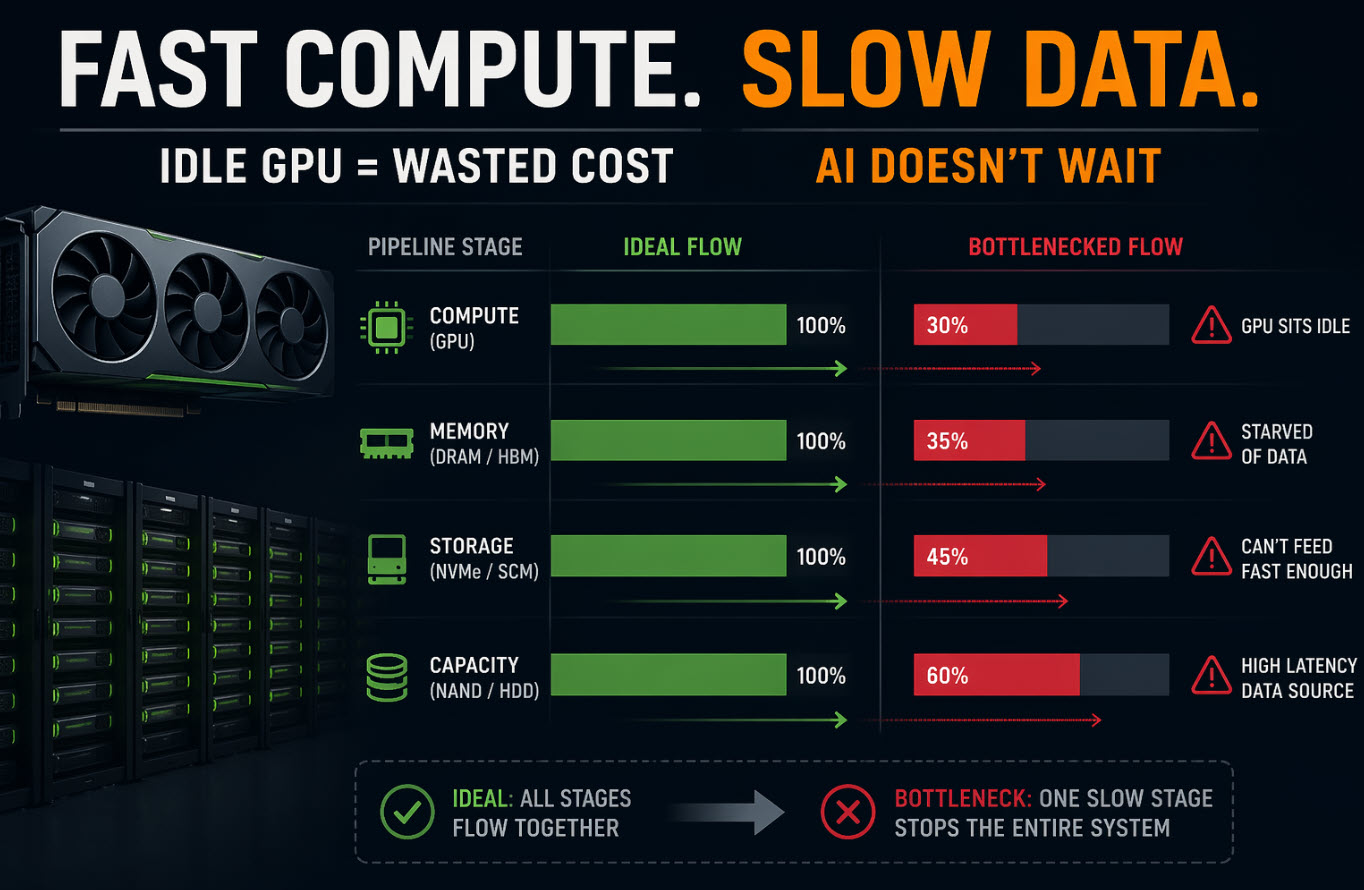

Eines der interessanteren Dinge an KI-Infrastruktur ist, dass sie Ineffizienzen sichtbar macht, die ältere Workloads größtenteils verbergen konnten. In einem traditionelleren System fällt eine kleine Verzögerung beim Datenzugriff möglicherweise kaum ins Gewicht. Der Prozessor wartet kurz, die Aufgabe endet etwas später, und der Benutzer merkt davon nichts. KI-Systeme sind viel weniger nachsichtig, weil sie mit so viel Parallelität arbeiten und weil im Compute-Layer so viel Geld gebunden ist.

Wenn eine GPU die Daten nicht dann bekommt, wenn sie sie braucht, ist das nicht nur eine technische Unannehmlichkeit. Es ist teure Leerlaufzeit. Multipliziert man das über viele Beschleuniger hinweg, die parallel arbeiten, dann schlagen selbst sehr kleine Verzögerungen plötzlich als reale Verluste in der Auslastung durch.

Dadurch verschiebt sich das Ziel. Es geht nicht einfach nur darum, schnellen Speicher zu haben. Es geht darum, die Datenlieferung konsistent genug auf einem großen Maßstab zu halten, damit die teuersten Teile des Systems die ganze Zeit beschäftigt bleiben. Das ist eine deutlich härtere Anforderung, und genau deshalb wirkt DRAM allein irgendwann nicht mehr ausreichend, sobald KI-Infrastruktur über einen bestimmten Punkt hinauswächst.

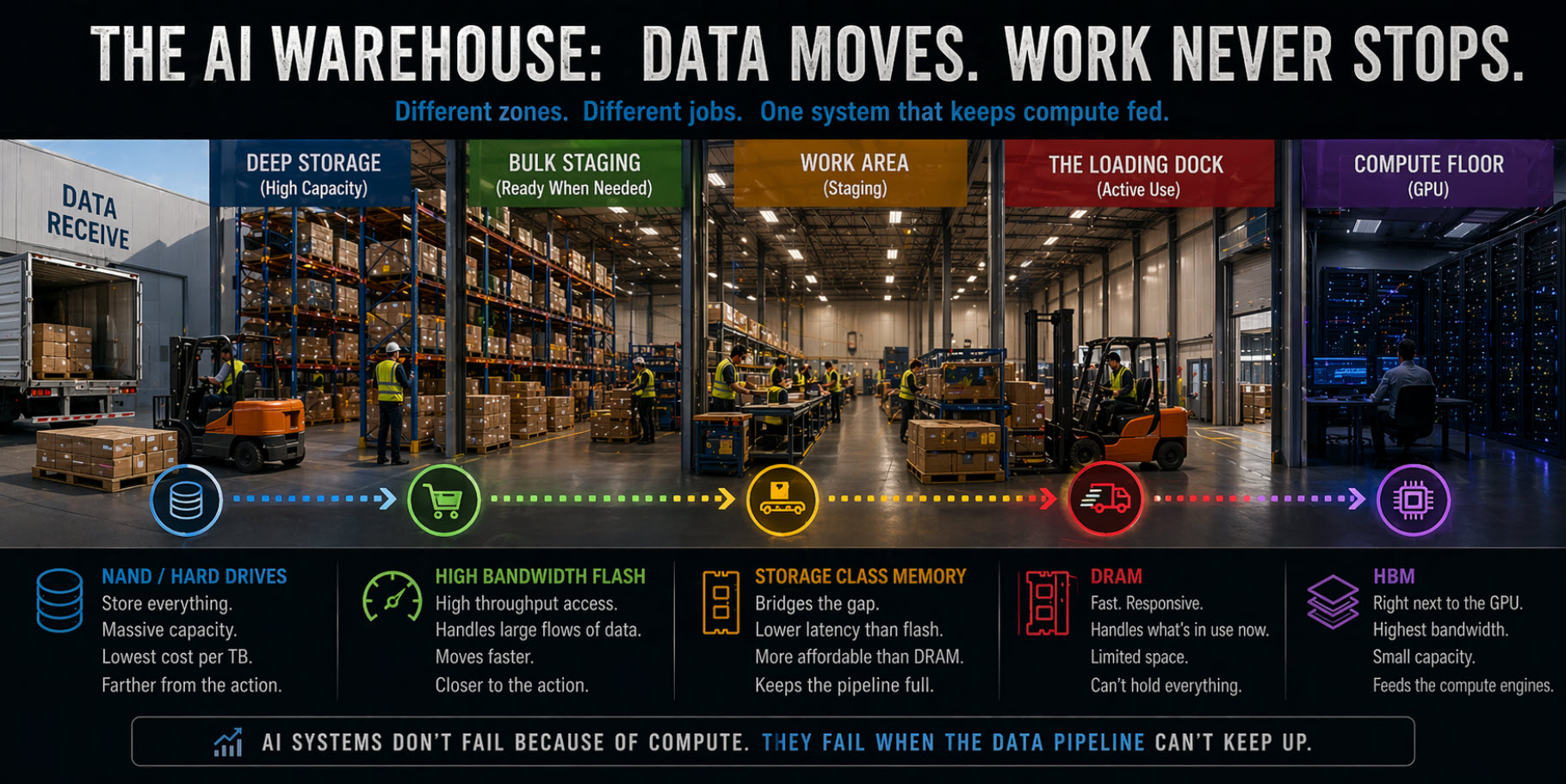

Die Lagerhaus-Analogie funktioniert immer noch – sie wird nur größer

Wenn wir bei derselben Lagerhaus-Analogie bleiben wie in den früheren Artikeln, dann ist DRAM immer noch die Laderampe. Dort findet die aktive Arbeit statt, dort werden Dinge geöffnet, sortiert und in die unmittelbare Nutzung gebracht. Jahrelang hat dieses Modell gut funktioniert, weil die Menge an Aktivität an der Rampe beherrschbar war und das System nicht verlangte, dass alles gleichzeitig dort bereitgestellt wird.

KI verändert die Größenordnung dieses Betriebs. Jetzt soll die Rampe einen nahezu konstanten Strom an Material bewältigen, mit viel mehr parallelen Abläufen und deutlich weniger Toleranz für Verzögerungen. Irgendwann kann selbst die beste Laderampe nicht einfach immer weiter wachsen. Es gibt nur so viel Platz, nur so viele parallele Bewegungen, die effizient stattfinden können, und nur so viel Bestand, den man direkt am Nutzungspunkt lagern kann, bevor das Layout selbst Teil des Problems wird.

Die Antwort ist also nicht, die Rampe unendlich groß zu machen. Die Antwort ist, den Arbeitsablauf rund um sie neu zu gestalten.

Genau dort beginnt der Rest der Speicherhierarchie seinen Platz zu verdienen. HBM hält die zeitkritischsten Daten direkt neben dem Prozessor. Storage Class Memory hilft dabei, den Übergang zwischen aktivem Speicher und langsamerem Storage abzufedern. Und im neueren Artikel darüber, warum moderne KI-Systeme so viel Speicher benötigen, verlagerte sich der Fokus darauf, wie auch die Storage-Seite neu gedacht wird, damit sie intelligenter an der Versorgung des Systems teilnehmen kann.

Keine dieser Schichten existiert, weil DRAM versagt hätte. Sie existieren, weil KI aus der Vorstellung herausgewachsen ist, dass eine einzige schnelle Ebene die gesamte Arbeitslast allein tragen könnte.

Was das wirklich für den KI-Speicher-Stack bedeutet

Die eigentliche Erkenntnis hier ist nicht, dass DRAM verschwindet, denn das tut es ganz offensichtlich nicht. DRAM bleibt einer der wichtigsten Teile des gesamten Stacks. Was sich ändert, ist seine Rolle. Statt der Ort zu sein, an dem alles Aktive leben soll, wird DRAM zunehmend zu dem Ort, an dem die dringendsten und zeitkritischsten Daten liegen, während andere Ebenen die wachsende Last aus Skalierung, Kosten und Kapazität übernehmen.

Das ist eine subtile Veränderung, aber eine wichtige. Sie bedeutet, dass sich KI-Infrastruktur vom älteren Gedanken eines einfachen Zwei-Schichten-Modells entfernt – Speicher hier, Storage dort – und sich auf etwas deutlich Nuancierteres zubewegt, bei dem verschiedene Technologien jeweils den Teil der Arbeitslast übernehmen, für den sie am besten geeignet sind.

Einfach gesagt: DRAM bleibt unverzichtbar, aber es reicht für sich allein nicht mehr aus. KI hat die Größe des Working Sets verändert, die Geschwindigkeit der Compute-Ebene, die Kosten von Verzögerung und die wirtschaftlichen Bedingungen dafür, alles nah beieinander zu halten. Wenn sich all das gleichzeitig verändert, muss sich auch die Speicherhierarchie mitverändern.

Wohin das als Nächstes führt

Sobald man akzeptiert, dass DRAM sich nicht weit genug strecken kann, um alles zu halten, was KI in der Nähe von Compute haben möchte, wird die nächste Frage ziemlich offensichtlich. Wo lebt der Rest dieser Daten eigentlich, vor allem dann, wenn die Datenmenge viel zu groß ist, um sie sinnvoll im Speicher zu halten?

Genau an dieser Stelle dreht sich die Diskussion erneut, und eine Technologie, von der viele glauben, dass sie längst an den Rand gedrängt wurde, wird plötzlich wieder überraschend wichtig. Denn während DRAM mit Skalierung kämpft und Flash weiterhin seine eigenen Kosten- und Latenz-Kompromisse mitbringt, bieten Festplatten noch immer etwas, das der Rest des Stacks nur schwer ersetzen kann: praktikable Kapazität in enormem Volumen.

Und genau deshalb muss der nächste Teil dieser Serie darauf schauen, warum Festplatten für KI-Infrastruktur weiterhin kritisch sind.

Über den Autor

Dieser Artikel wurde unter der Leitung von Greg Morris entwickelt, einem langjährigen Mitwirkenden bei GetUSB.info mit über zwei Jahrzehnten Erfahrung in den Bereichen USB-Technologie, Verhalten von Flash-Speicher und Datenspeichersysteme. Die hier dargestellte Perspektive beruht auf praktischer Branchenerfahrung und laufender Analyse dazu, wie sich reale Systeme unter sich wandelnden Workloads verhalten, einschließlich KI-Infrastruktur.

Wie dieser Artikel erstellt wurde

Die Konzepte, die Struktur und die technische Ausrichtung dieses Artikels wurden von einem menschlichen Fachexperten verfasst und geprüft. KI-Werkzeuge wurden genutzt, um Rhythmus, Fluss und Lesbarkeit zu unterstützen und komplexe Ideen in eine natürlichere Erzählform zu bringen, ohne die zugrunde liegende technische Genauigkeit oder die eigentliche Aussage zu verändern.

Über die Visuals

Die in diesem Artikel verwendeten Bilder wurden speziell erstellt, um Konzepte zu veranschaulichen, die sich mit klassischer Stockfotografie nur schwer darstellen lassen, etwa Datenfluss-Engpässe, das Verhalten der Speicherhierarchie und Ineffizienzen auf Systemebene. Die Visuals sollen die technischen Erklärungen verstärken und die Verständlichkeit für die Leser verbessern.